Nach unserem Ebenbild?

Künstliche Intelligenz: Selbstfahrende Autos, Kampfroboter, digitale Prozesse – Maschinen übernehmen immer mehr Entscheidungen. Aber haben sie auch Verantwortung?

Es war ein ungewöhnliches Treffen: EKD-Ratsvorsitzender Heinrich Bedford-Strohm trifft am Rande der EKD-Ratssitzung in Wuppertal auf den Computer-Roboter »Pepper«. »Ich möchte mit Ihnen über Digitalisierung reden«, sagt der »Pepper« mit großen Augen zu Bedford-Strohm. Dafür ist es höchste Zeit. Denn die mächtigsten Technikkonzerne der Welt arbeiten längst an der Künstlichen Intelligenz. Doch in Kirche und Theologie sieht man noch distanziert zu.

»Nach der Reformationsdekade muss nun die Digitalisierungsdekade kommen. Es gibt viele offene Fragen aus theologischer und ethischer Sicht, die einer Klärung bedürfen«, sagt der Leipziger Unternehmensberater Friedhelm Wachs, der zusammen mit dem Roboter »Pepper« am vergangenen Freitag dem EKD-Chef ein Impulspapier des Arbeitskreises Evangelischer Unternehmer (AEU) zur »digitalen Revolution« übergibt. Bedford-Strohm sagt zu: »Die Digitalisierung steht jetzt ganz oben auf unserer Agenda.«

Doch das ist eine große Herausforderung für die Kirche. Denn immer mehr Computer können selbständig lernen und dann etwas tun, was bisher nur Menschen konnten: eigenständig Entscheidungen treffen. In Pflegeheimen begleiten heute schon erste Roboter alte Menschen. Im Internet verbreiten Roboter – sogenannte »Social Bots« – falsche Nachrichten und machen Stimmung. Und automatisierte Autos müssen in einer Gefahrensituation entscheiden: Schützt es eher seine Insassen oder die Fußgänger auf der Straße – welches Leben ist mehr wert? Von Kampfrobotern nicht zu reden.

Können Maschinen so etwas wie Ethik lernen? Ja, sagt der Dresdner Theologieprofessor Christian Schwarke, der an der Technischen Universität an der Schnittstelle zwischen Technik und Ethik forscht. Fragt man nur, welches Verhalten den größten Nutzen für das Wohlergehen aller bringt, »dann können das Computer besser herausfinden als wir«, erwartet Schwarke. »Schach-Computer arbeiten solche Entscheidungen auch besser und schneller ab. Das Problem ist nur, dass es sehr unterschiedliche ethische Ansätze gibt.« Zum Beispiel Grundwerte aus dem Glauben wie das absolute Tötungsverbot. Doch Roboter haben kein Gewissen. Und sie können auch böse handeln, ohne mit der Wimper zu zucken. Um das zu beweisen, hat der Maschinen-Ethiker Oliver Bendel einen Lügen-Roboter konstruiert, der im Internet Falschmeldungen verbreitet. Er wolle zeigen, so Bendel, dass es ohne Weiteres möglich sei, unmoralische Maschinen zu bauen.

Aber trägt dann der selbst handelnde Computer auch die Verantwortung? »Zunächst werden wir uns als Urheber dieser Maschinen nicht aus der Verantwortung herausnehmen können – wie Eltern, die für ihre Kinder haften«, betont Schwarke. Doch wenn er in die Zukunft blickt, muss er an die biblische Schöpfungsgeschichte denken. Sie handelt von einem Schöpfer, der autonom handelnde Geschöpfe erschafft. Und die sorgen mit ihrer Selbständigkeit bald auch für einigen Ärger.

»Wenn unsere Gottebenbildlichkeit in der Funktion als Stellvertreter Gottes auf Erden besteht, dann könnte dazu gehören, dass auch wir etwas zu unserem Bilde erschaffen können – wie Roboter«, überlegt Schwarke. Das hätte Konsequenzen. Bei Versuchen mit Robotern in der Altenpflege entwickelten Bewohner eine Beziehung zu ihnen. Es ist möglich, dass Menschen diesen Maschinen eines Tages eigene Rechte zuerkennen. Oder gar so etwas wie Würde. »Denkbar ist auch, dass sich unsere Vorstellungen von Schuld und Verantwortung in der Konfrontation mit autonomen Maschinen verändern«, sagt der Ethiker Christian Schwarke. Die Antwort auf diese großen Fragen überlässt die Kirche bisher Technikkonzernen wie Google & Co.

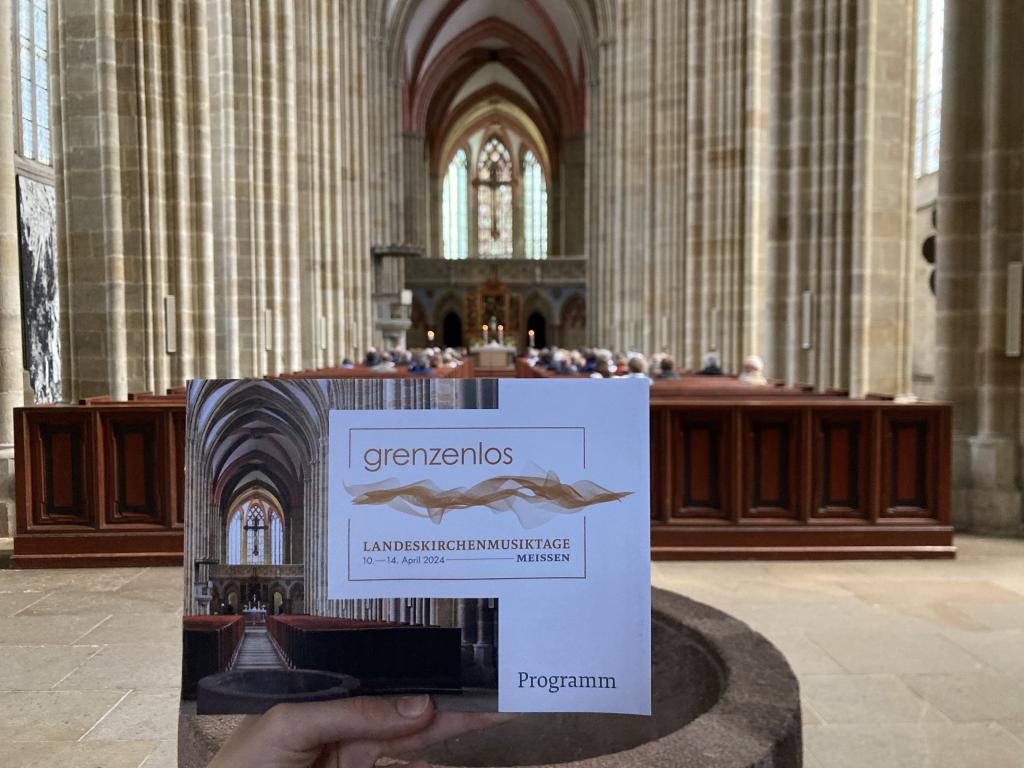

Impressionen vom Elbe-Tauffest

Impressionen vom Elbe-Kirchentag in Pirna